体验本地部署 DeepSeek-r1 服务 (qq.com)

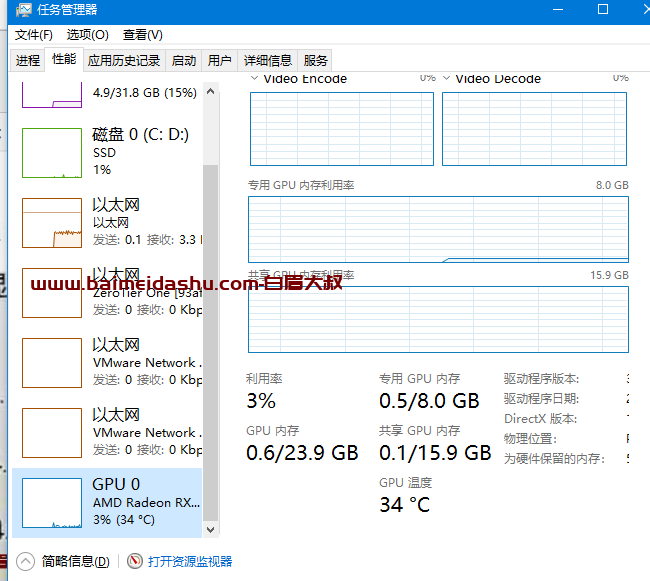

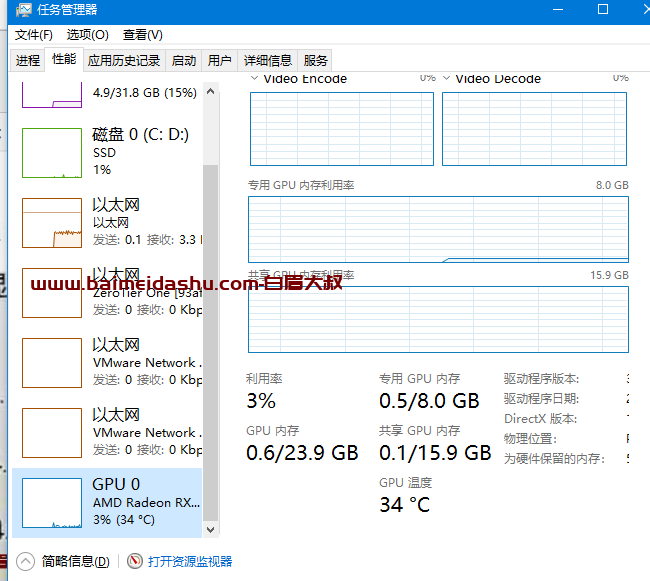

共享gpu内存:

划出一部分内存当显存用,类似内存的swap。某些游戏在画面选项开很高的时候会出现爆显存的情况,即游戏使用的显存大于你的真实显存大小,这个时候一部分数据会移到内存里,由于内存和显存的带宽不在一个水平线上,所以游戏会出现非常明显的帧数下滑。

2024年12月26日晚,正式上线 DeepSeek-V3 首个版本并同步开源,逼近GPT-4o、Claude-3.5-Sonnet等顶尖闭源模型,一夜爆火引发业界广泛关注。

DeepSeek 是一个开源模型,大家都可以通过本地来安装部署,在自己的电脑终端上随时训练学习使用!

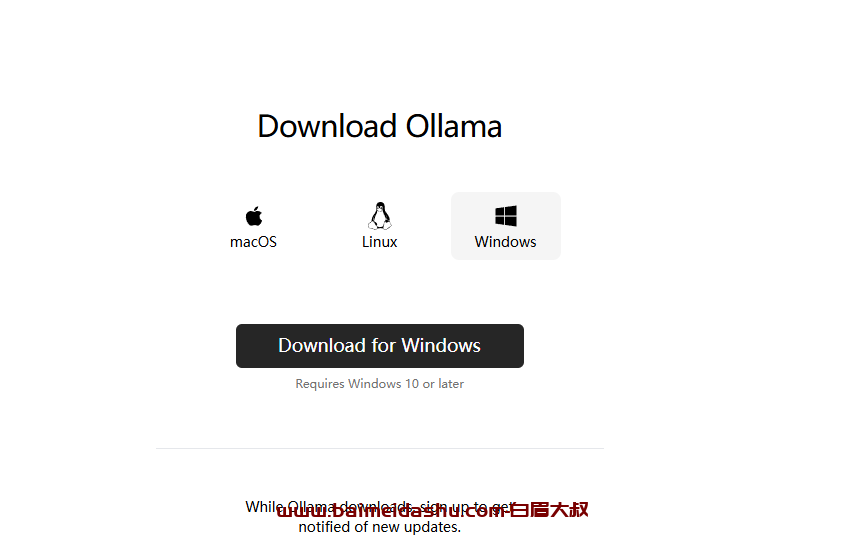

直接本地 Windows 系统安装部署,操作系统如下:

https://ollama.com/download

下载的 OllamaSetup.exe 安装文件,共 745 M,然后双击进行安装,安装也很快,安装完成后安装窗口会自动关闭,你的系统托盘图标会出现一个常驻的 Ollama 图标,如下图所示。

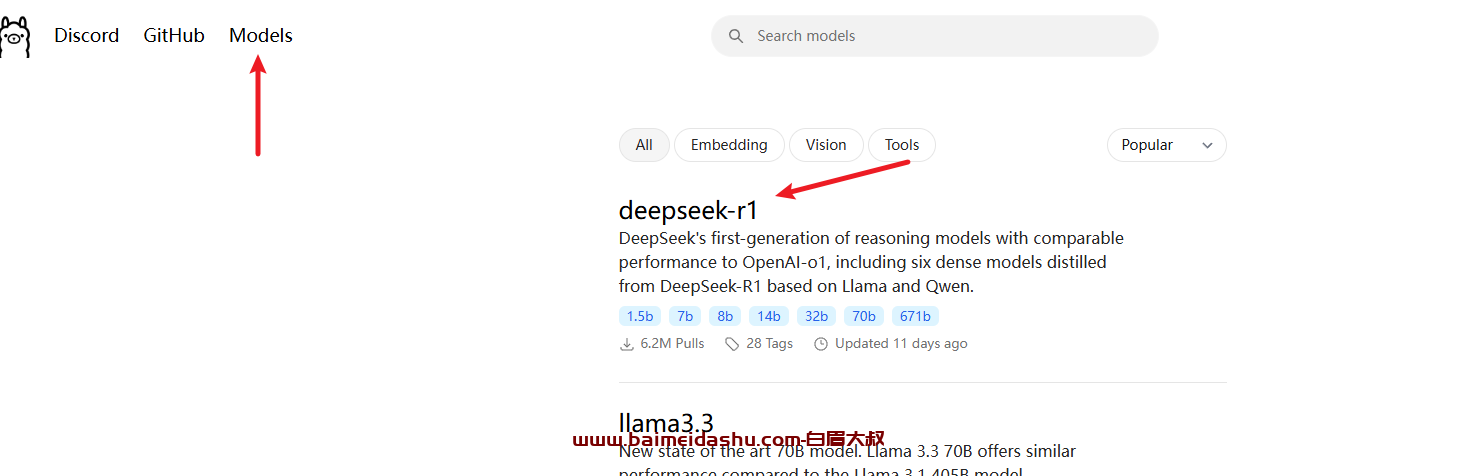

接着在 Ollama 官网左上方的 Models 链接按钮,会列出目前最火的DeepSeek-R1 排在第一位置,点击进入主题。

官方的提示: DeepSeek 的第一代推理模型具有与 OpenAI-o1 相当的性能,包括基于 Llama 和 Qwen 从 DeepSeek-R1 中提取的六个密集模型。

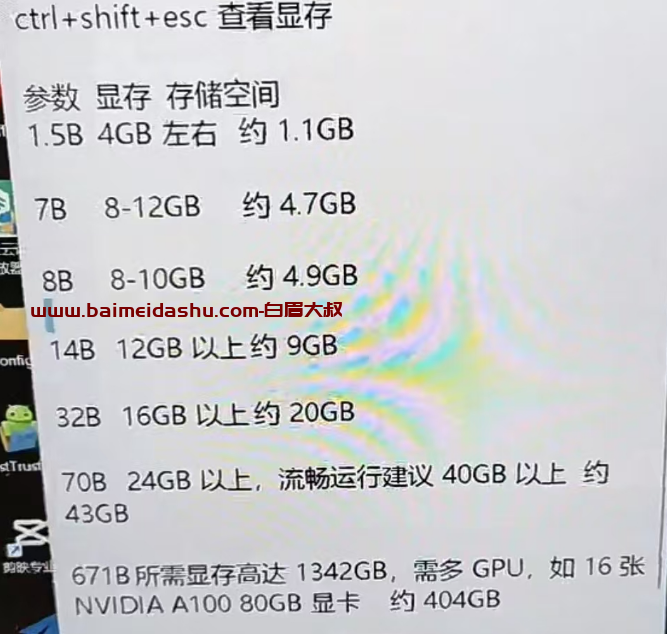

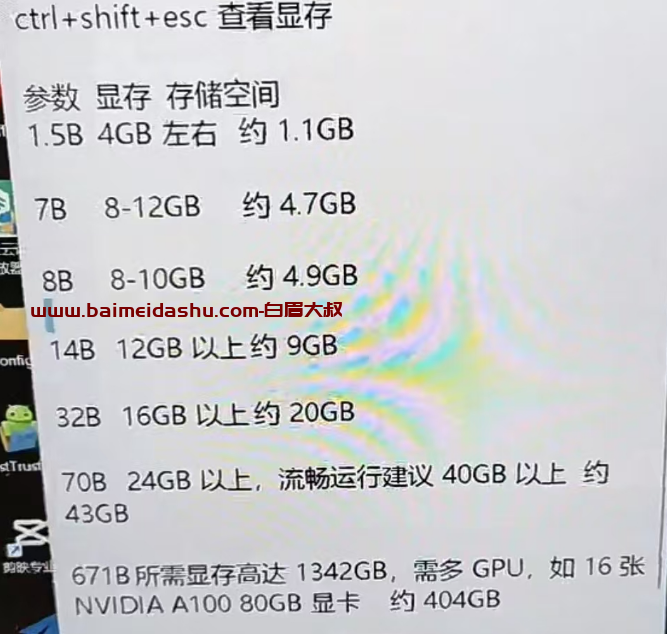

按自己电脑的配置,看看显卡显存有多大,选择相应的版本下载即可,这数字越大,对显存要求也就越高,所以看看自己的配置能支持多少

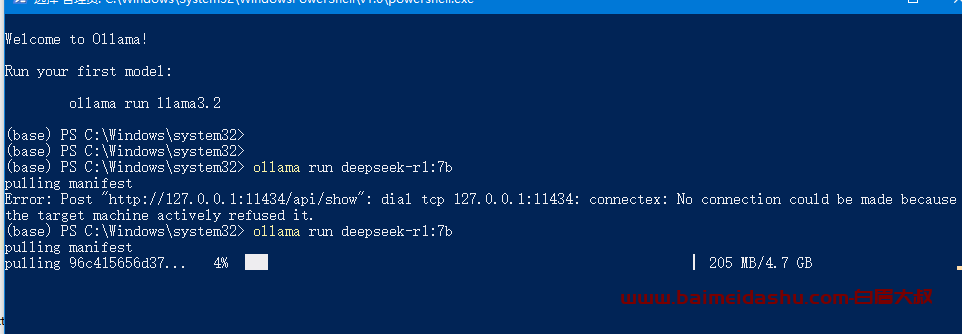

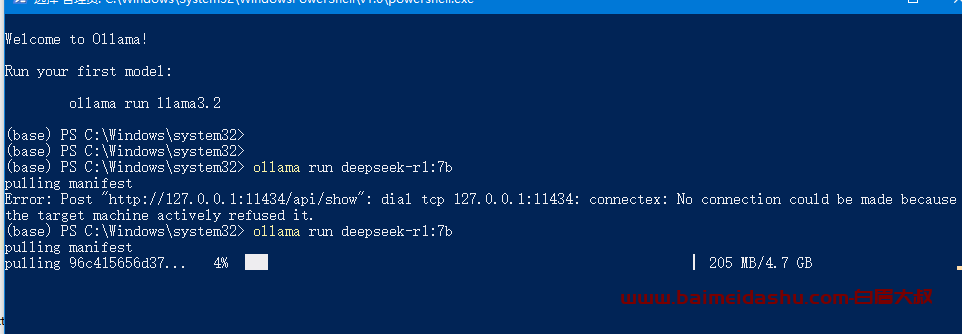

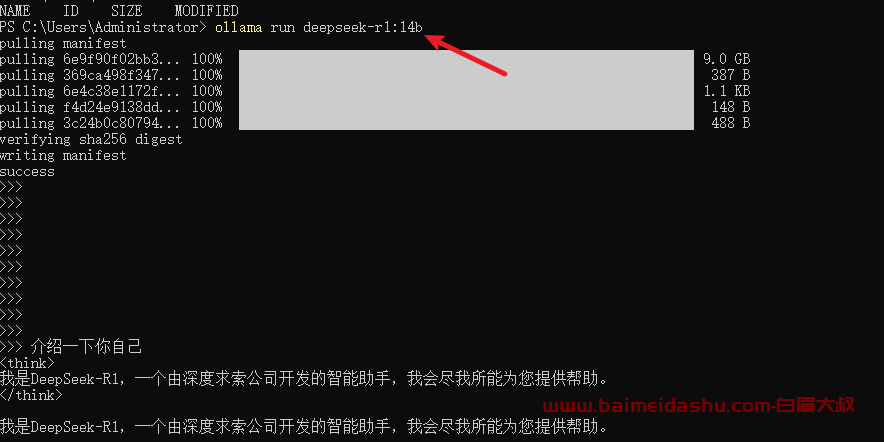

打开一个 cmd 窗口,选择好模型,就开始下载了,如下图所示。

ollama run deepseek-r1:7b

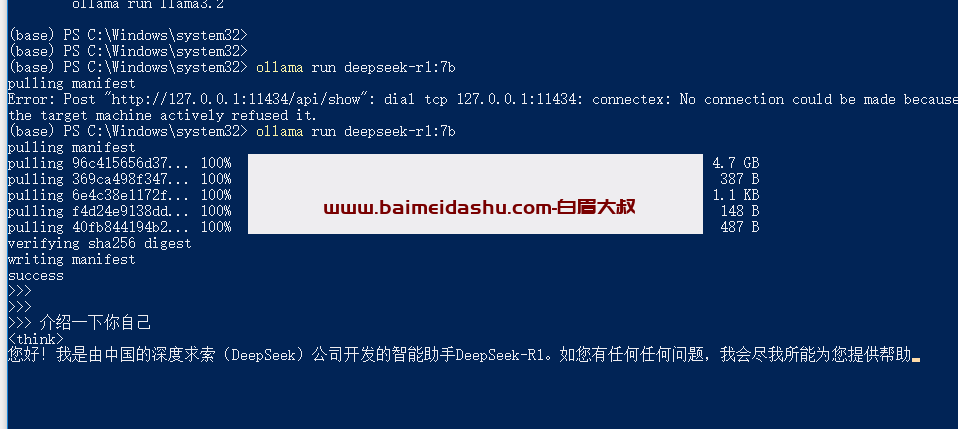

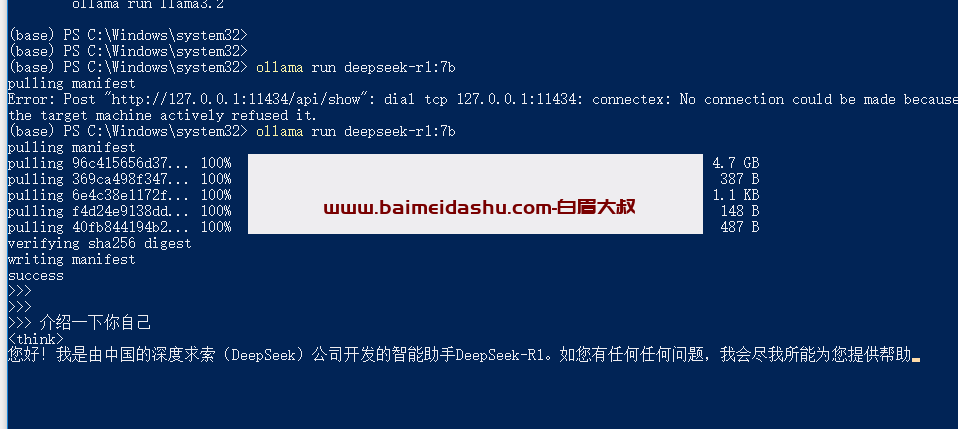

保持网络畅通,下载完成之后,会显示 success 就说明部署成功了。

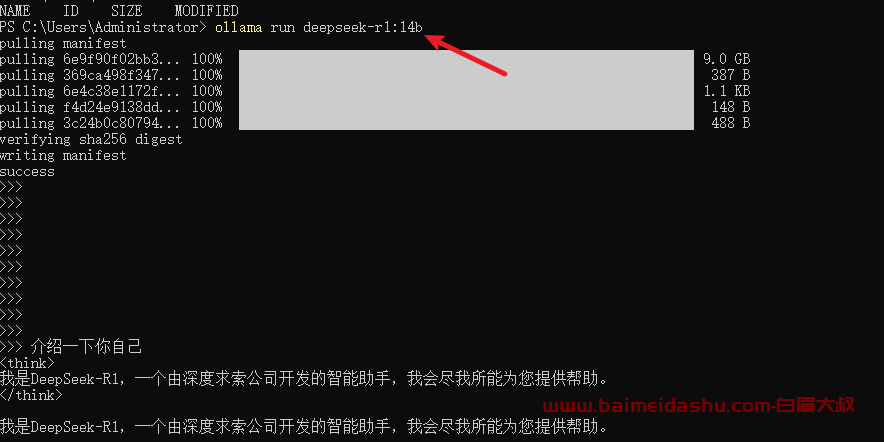

然后我们跟 DeepSeek 来个简单的对话

14b

ollama run deepseek-r1:14b

欢迎来撩 : 汇总all